Instalował ktoś UTM w swoim domu? Myślicie że to overkill?

https://firebox.com.pl/firebox-t20-basic-security-suite.html

#utm #security #siecikomputerowe

https://firebox.com.pl/firebox-t20-basic-security-suite.html

#utm #security #siecikomputerowe

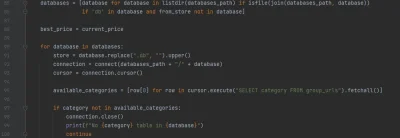

źródło: comment_1647809685UUvVSs61rJEOqBBXHEGwrb.jpg

Pobierz

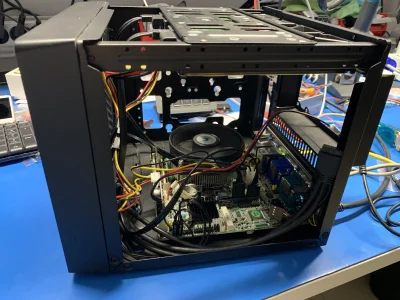

źródło: comment_1611301683Luyd9uICRBH4SQJGkDwMwb.jpg

Pobierz

Mając na uwadze, jak HDMI Forum potraktowało podmioty niezależne, wydaje się, że to w tej chwili jedyne słuszne rozwiązanie. TL;DR Jednostka odpowiedzialna…

zRocznica

od 09.04.2024

Mikroblogger

od 12.05.2017

Regulamin

Reklama

Kontakt

O nas

FAQ

Osiągnięcia

Ranking

Rodzina się nami nie interesuje, jestem tylko ja i Mama. Nie mam nikogo do pomocy, nie

Komentarz usunięty przez moderatora