Chat GPT - papież Franciszek nie żyje

Meta AI - papież Franciszek nie żyje

Gemini - papież Franciszek żyje

DeepSeek - papież Franciszek żyje

Wszystko

Najnowsze

Archiwum

8

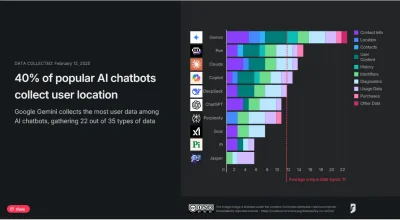

Chociaż to było do przewidzenia, to teraz jest już pewne. Chiński lider na rynku sztucznej inteligencji ochoczo szpiegował użytkowników i ich komputery.

z

źródło: temp_file6326228361427381373

PobierzDeepSeek - papież Franciszek żyje

Nie chcę korzystać z tłumacza, ponieważ często błędnie tłumaczy, nie uwzględnia kontekstu i ogólnie nie jest dokładny.

1

FIlm metin2 wygenerowany przez AI

z9

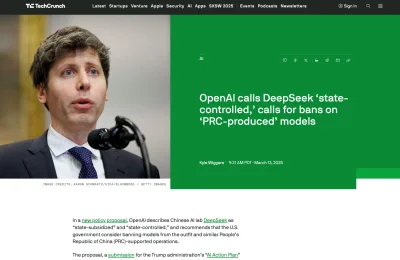

Praktycznie od samego początku swojego istnienia DeepSeek wzbudza sporo kontrowersji. Chińska odpowiedź na ChatGPT zosta

z

źródło: Screenshot 2025-03-11 at 13-51-12 30% of popular AI chatbots share data with third parties

Pobierz7

Przeszukiwanie zasobów w poszukiwaniu kluczy API nie jest nowatorską praktyką i bywa bardzo często wykorzystywane przez

z33

Przegląd najlepszych darmowych narzędzi AI w 2025 roku. Porównanie funkcji, zalet i ograniczeń 9 popularnych platform wraz z linkami do nich...

zRegulamin

Reklama

Kontakt

O nas

FAQ

Osiągnięcia

Ranking

#openai #chatgpt #ai #sztucznainteligencja #deepseek