Aktywne Wpisy

SmakoszKotow +31

źródło: szkodastrzepicryja

Pobierz

SirSherwood +153

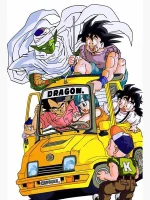

Autor Dragon Balla, Akira Toriyama umarł

rip i dzięki ziomek za dragonballa

rip i dzięki ziomek za dragonballa

źródło: flat,750x,075,f-pad,750x1000,f8f8f8

Pobierz

Mam kilka komputerów z których pobieram regularnie pliki CSV przez Teamviewera. Dane z tych plików wrzucam sobie do PowerBI i robię z nich raporty.

Dane do tych plików CSV są generowane co kilka minut i najlepszym rozwiązaniem było by, gdybym mógł ustawić całość tak, aby pliki te leciały bezpośrednio do chmury, z której ja wówczas mógłbym sobie je pobrać automatycznie do PowerBI.

Nie mam niestety doświadczenia w ustawianiu takich rzeczy, bo głównie zajmuję się analizą ustawień pewnych maszyn i zmieniam ich ustawienia w zależności od tego co trzeba poprawić.

O wiele łatwiej by mi się pracowało, gdybym mógł sobie wszystko przejrzeć na żywo w jednym miejscu, np w takim dashboardzie w PowerBI, czy Tableau.

Czy ma ktoś może jakiś pomysł/wskazówkę jak najmądrzej możnaby to ustawić?

Będę wdzięczny za jakiekolwiek porady ( ͡° ͜ʖ ͡°)

#csv #sql #datascience #analizadanych

1. sprawdza czy jest nowy plik

2. jak jest to go otwiera, parsuje, ładuje do jakiejś bazy danych w chmurze,

3. jak już to zrobi to przenosi gdzies plik lub usuwa

potem tylko PBI łączysz z tą bazą.

ak, pliki są generowane przez program, który sczytuje dane z sensorów równo co 5 minut. Dane trafiają zawsze do tego samego pliku.

CSVki z komputera u klienta zrzucałem za pomocą Robocopy na Google Drive, a stamąd synchronizowałem je na swojego kompa i łączyłem moje PowerBI właśnie z tymi plikami.

Niestety całość działała trochę nieefektywnie, trzeba było czekać kilkanaście sekund, żeby wszystkie połączenia się uruchomiły.

jak sobie to wystawisz to wtedy tylko ten skrypt trzeba uruchomić na wszystkich.

Ja tylko hobbystycznie pisałem takie skrypty

Spróbuję z FreeFileSyncem.

Dzięki za rady! @obieq @malinowy_krol